بهبود تصویربرداری حالت پرتره در پیکسل 3 و پیکسل 3 ایکس ال با یادگیری ماشین

گوگل با استفاده از یادگیری ماشین، تصویربرداری حالت پرتره را در گوشیهای پیکسل ۳ و پیکسل ۳ ایکس ال بهبود بخشیده است.

گوشیهای هوشمند پیکسل ۳ و پیکسل ۳ ایکس ال از بهترین سیستمهای دوربین موجود در گوشیهای هوشمند امروزی برخوردار هستند. در حالی که گوگل در هر دو گوشی هوشمند، تنها یک دوربین در پنل پشتی قرار داده است و بدون وجود دوربین ثانویه، هر دو با استفاده از نرمافزار و سایر ترفندهای پردازش تصویر، اثر بوکه را در حالت پرتره بهخوبی ایجاد میکنند.

گوگل در پست وبلاگ خود اعلام کرد که چگونه توانسته است عمق تصویر را در گوشی Pixel 3، بدون استفاده از دوربین ثانویه اندازهگیری کند. سال گذشتهی میلادی، گوگل در گوشیهای هوشمند Pixel 2 و Pixel 2 XL از فوکوس تشخیص فاز (PDAF) استفاده کرد که اتوفوکوس با دوربین دوگانه نیز نامیده میشود و برای گرفتن تصاویر پرتره در نسل دوم گوشیهای پیکسل، از الگوریتم استریوی سنتی غیریادگیرنده (traditional non-learned stereo) استفاده کرد.

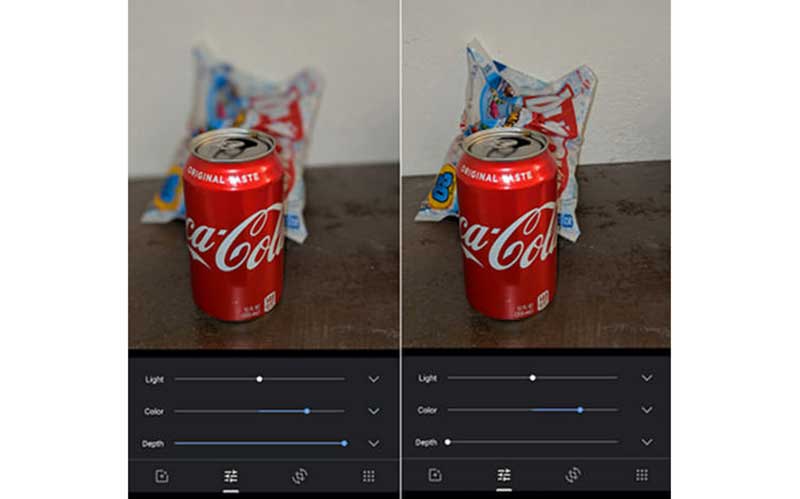

PDAF دو نمای نسبتا متفاوت از یک صحنهی مشخص را تهیه میکند که باعث ایجاد اثری به نام اختلاف منظر (parallax) در تصاویر گرفتهشده میشود و با استفاده از اختلاف منظر، میتواند اثر بوکه را روی تصویر نشان دهد. کاربران گوشیهای مدل ۲۰۱۷، میتوانستند تصاویر پرترهی عالی که پسزمینهی آنها بهخوبی حالت تاری را نشان میدهد، بگیرند. همچنین امکان تغییر شدت تار شدن پسزمینه در اختیار کاربران قرار داده شده بود. گوگل در گوشیهای Pixel 3 و Pixel 3 XL در نظر داشت که امکان گرفتن تصاویر پرترهی بهتر را تقویت کند.

در حالی که فوکوس تشخیص فاز (PDAF) بهخوبی عمل میکند، عواملی هم وجود دارد که میتواند منجر به بروز خطاهایی در تخمین عمق تصویر در مدلهای پیکسل ۳ شود. با استفادهی نشانگر defocus depth، گوگل بین تصاویر گرفتهشده در حالت بدون فوکوس پسزمینه و تصاویر گرفتهشده در حالت فوکوس، مقایسه انجام میدهد. همچنین نشانگر semantic نیز تعداد پیکسلهای تصویر چهرهی سوژه را میشمارد و میتواند بهعنوان مقیاسی برای دور یا نزدیکبودن فرد به دوربین در نظر گرفته شود.

گوگل برای ترکیب نتایج خروجی این نشانگرها، نیاز به ایجاد الگوریتمی مبتنی بر یادگیری ماشین دارد تا در نهایت بتواند برآورد دقیقتری از عمق تصویر در اختیار داشته باشد؛ برای انجام این کار نیز، گوگل نیاز به آموزش دادن شبکهی عصبی دارد.

در راستای محقق شدن این موضوع، نیاز به تعداد زیادی تصویر PDAF با عمقهای مختلف و البته با کیفیت بالا وجود داشت. بههمین منظور، گوگل شرایطی را فراهم کرد که بتواند از طریق پنج گوشی پیکسل ۳ بهصورت همزمان تصویربرداری کند. با استفاده از اتصال وایفای، تصاویر هر پنج دوربین، بهصورت همزمان و با تاخیر زمانی تقریبا ۲ میلیثانیه نسبت به یکدیگر، گرفته شدند. پنج تصویر گرفتهشده، تفاوتهای مربوط به عمق تصویر را بهخوبی نشان میداد و نتایج کمک میکرد تا اطلاعات دقیقتری در مورد عمق تصویر در اختیار الگوریتم مبتنی بر یادگیری ماشین گوگل قرار گیرد. گوگل اعلام کرد:برای سنجش عمق تصویر مبتنی بر یادگیری ماشین، کاربران باید در گرفتن عکس با گوشی پیکسل ۳، سرعت عمل داشته باشند و نباید برای گرفتن عکسهای حالت پرتره زمان زیادی را صرف کنند. برای آنکه عمق تصویر بهخوبی اندازهگیری شود و برای استفاده از نشانگرهای parallax و defocus، باید عکس با رزولوشن بالا گرفته شود تا بتوانیم تصاویر چند مگاپیکسلی PDAF را در اختیار داشته باشیم. برای اطمینان از سرعت عمل، میتوان از TensorFlow Lite کمک گرفت که راهکاری پلتفرمی برای اجرای مدلهای مبتنی بر یادگیری ماشین در دستگاههای گوشی هوشمند و دستگاههای امبدد و واحد پردازشگر تصویر قدرتمند پیکسل ۳ برای محاسبهی سریع عمق، با وجود دادههای غیر طبیعی بزرگ است. در نهایت خروجی نهایی و عمق تصویر نمایشدادهشده، حاصل استفاده از فیلترهای مختلف شبکهی عصبی است که قسمتهای مختلف تصویر را تشکیل میدهد و نتیجهی نهایی، تصویری با حالت پرتره فوقالعاده زیبا خواهد بود.

گوگل همچنان از دوربینهای پیکسل برای فروش گوشیهای خود در بازار استفاده میکند. مجموعهای از ویدئوها تحت عنوان Unswitchables، نشان میدهد که دارندگان گوشیهای مختلف در حال تست پیکسل ۳ هستند تا ببینند در نهایت آیا تغییری در گوشی آنها رخ داده است یا خیر. در ابتدا، اکثر این افراد میگفتند که تغییری انجام نخواهند داد، ولی در پایان هر ویدئو از دوربین و ویژگیهای گوگل پیروزمندانه صحبت میکنند.